由于DeepSeek的火爆,用户访问过多,导致官方服务器多次宕机,这十分影响客户的体验性。

本篇文章将教大家如何在本地部署DeepSeek,让大家可以随时随地使用DeepSeek。

事先扫盲:

我们本地部署的大模型都不是DeepSeek,而是蒸馏后的模型,想要部署真实的r1或者v3,一般都是企业级的应用了

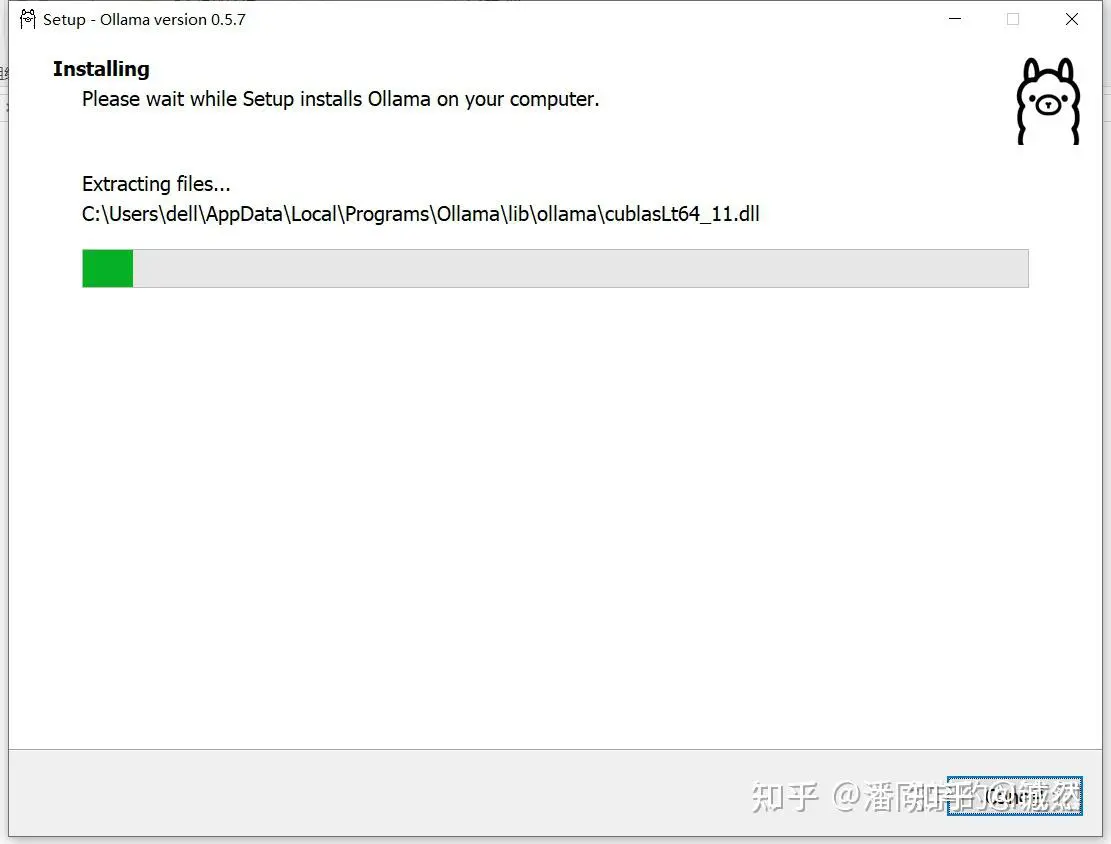

1.Ollama 下载安装

Ollama 是一个轻量级的本地AI模型运行框架,可在本地运行各种开源大语言模型(如Llama、Mistral等)

浏览器输入网址:https://ollama.com/

选择一个系统进行下载

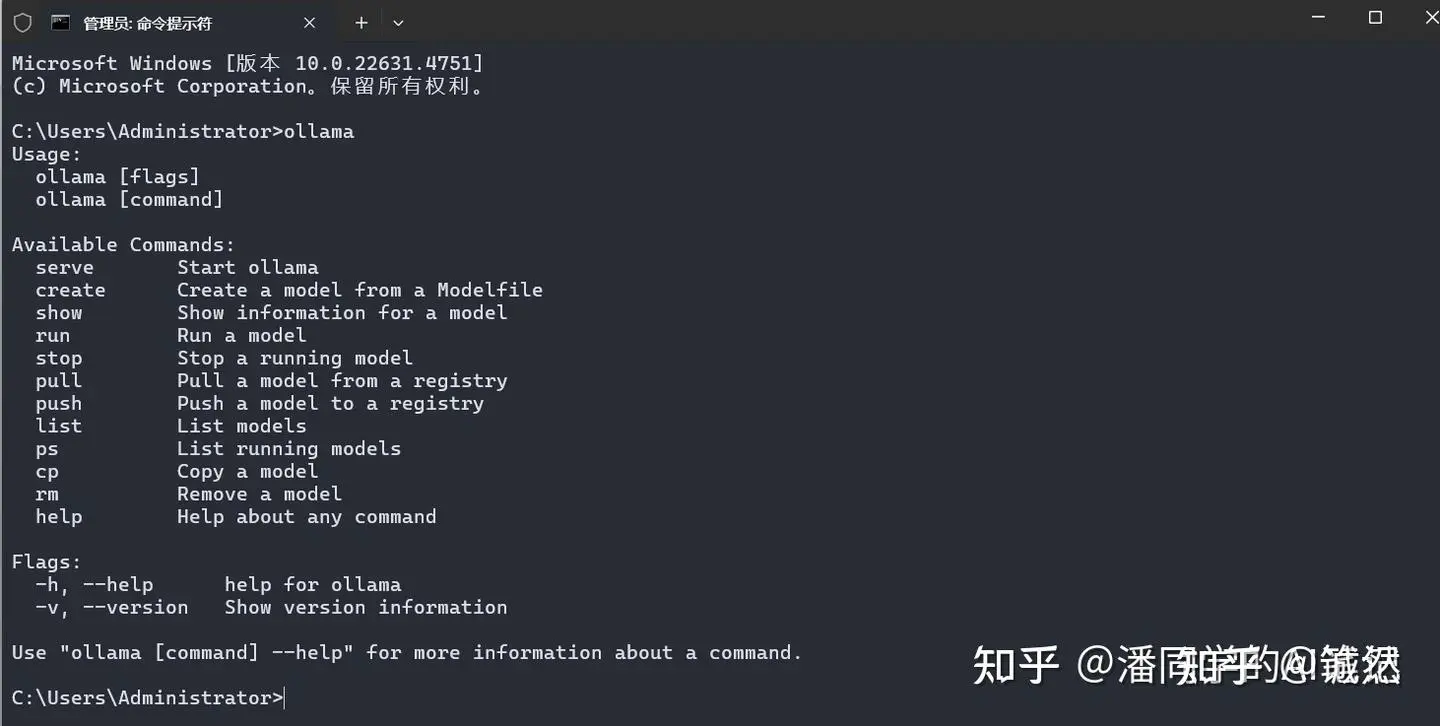

安装之后,Ollama已经运行了,它是CMD命令工具,我们可以在命令行输入ollama来验证,是否安装成功

如果出现下图的内容的话,就表示下载成功

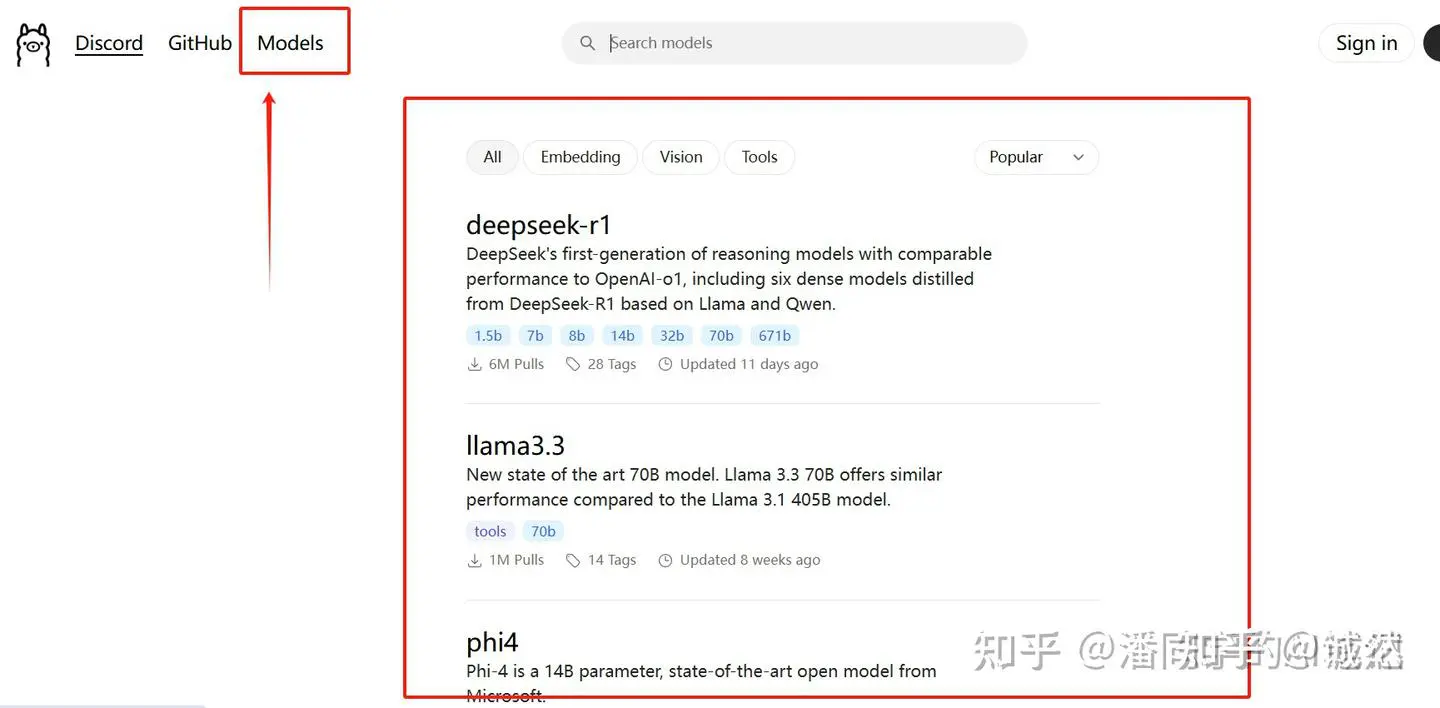

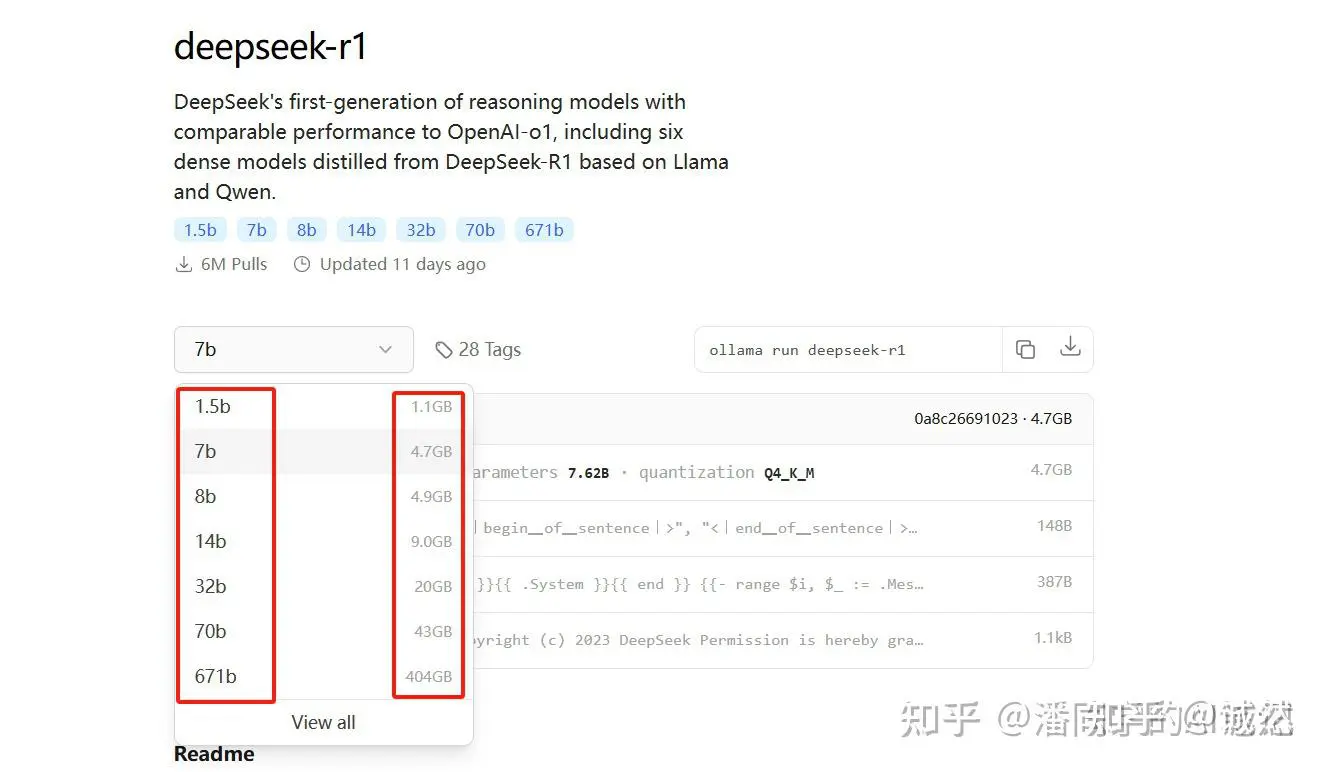

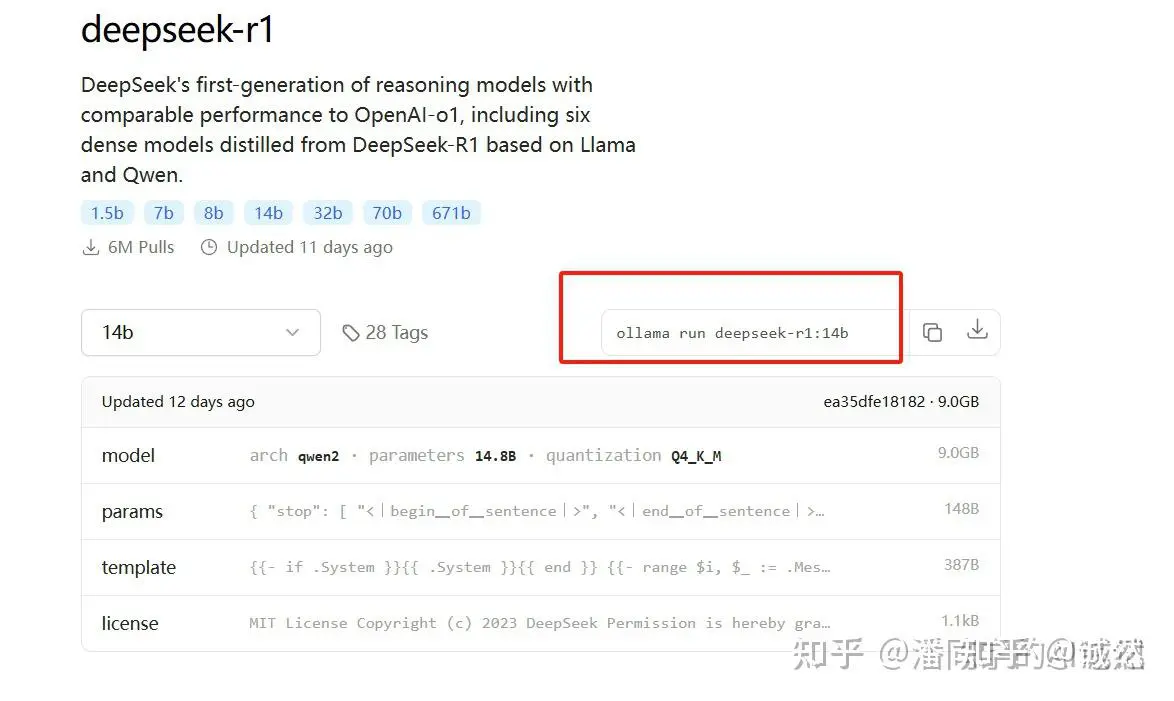

安装DeepSeek-r1模型 还是在刚才的Ollama网站,选择Model模块,选择deepseek-r1这个模型

搜索出来有很多个版本,区别就是参数不一样。

1.5b,7b,8b,14b,32b,70b,671b

每个版本对应所需的内存大小都不一样。

如果你电脑运行内存为8G那可以下载1.5b,7b,8b的蒸馏后的模型

如果你电脑运行内存为16G那可以下载14b的蒸馏后的模型

我这里选择14b的模型,参数越大,使用DeepSeek的效果越好

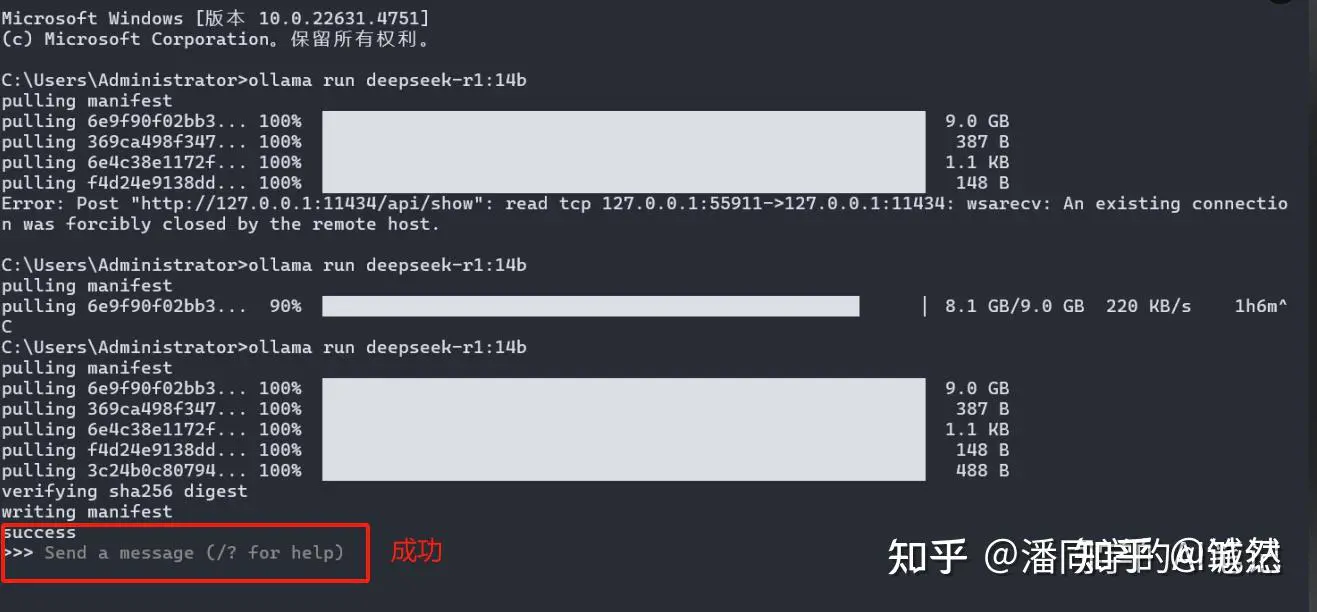

使用ollama run deepseek-r1:14b 进行下载

这里我第一次失败了,所以我试了两次,才成功。

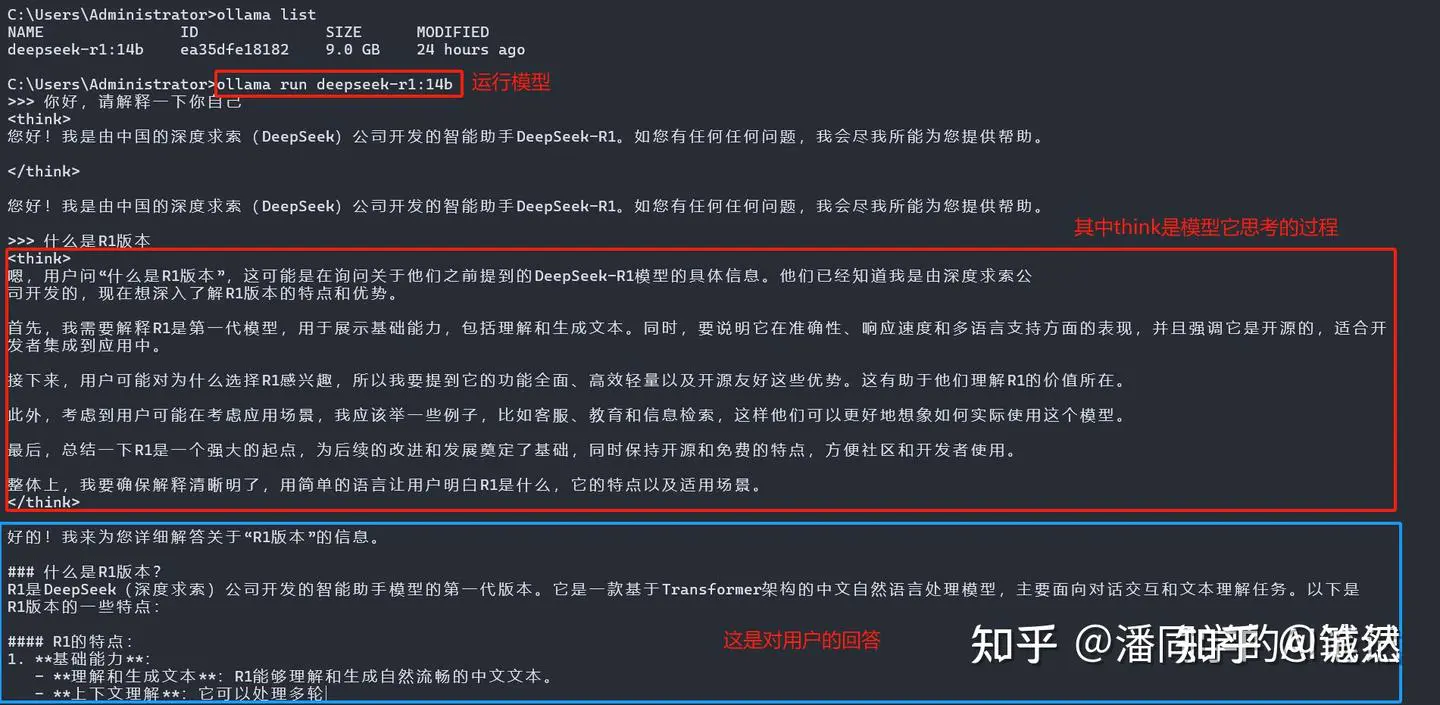

我们也可以在命令行中输入,ollama list 查看是否成功下载了模型,下图的内容表明下载成功

输入ollama run deepseek-r1:14b运行模型

启动成功后,就可以输入我们想问的问题,模型首先会进行深度思考(也就是think标签包含的地方),思考结束后会反馈我们问题的结果。

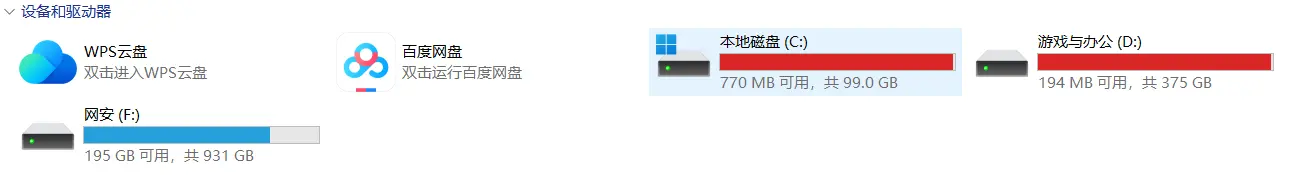

注意:由于ollama默认是将模型下载到C盘的,如果你的C盘空间也和我的一样拉跨

那我们就需要更改一下模型的下载位置了

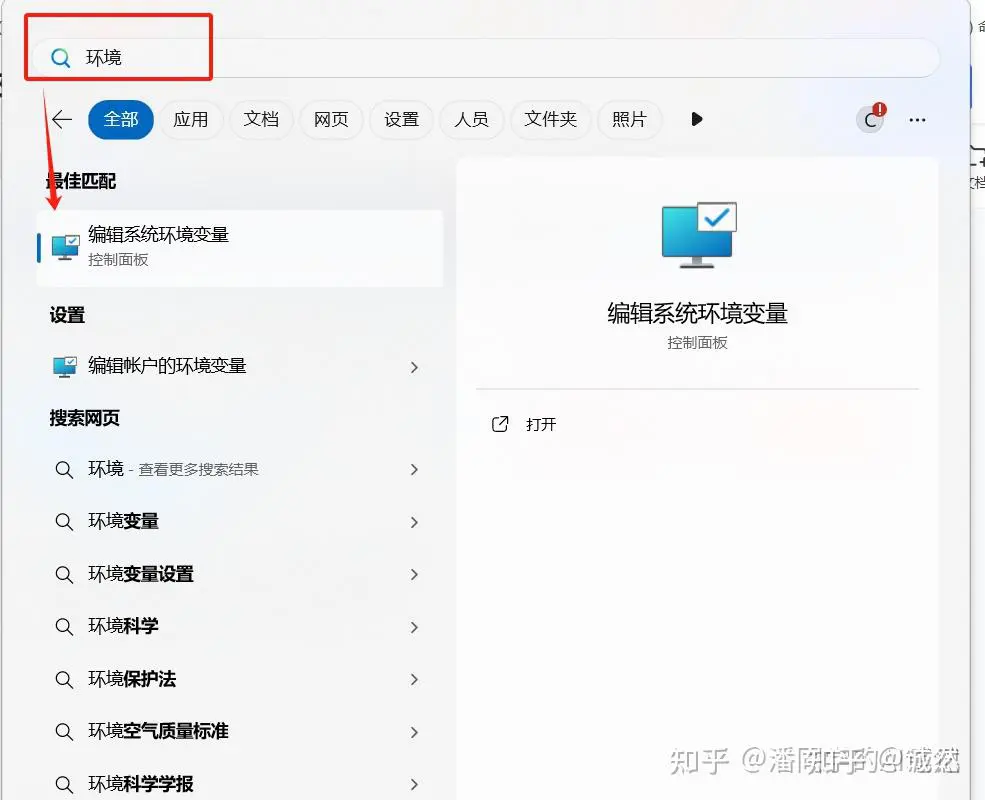

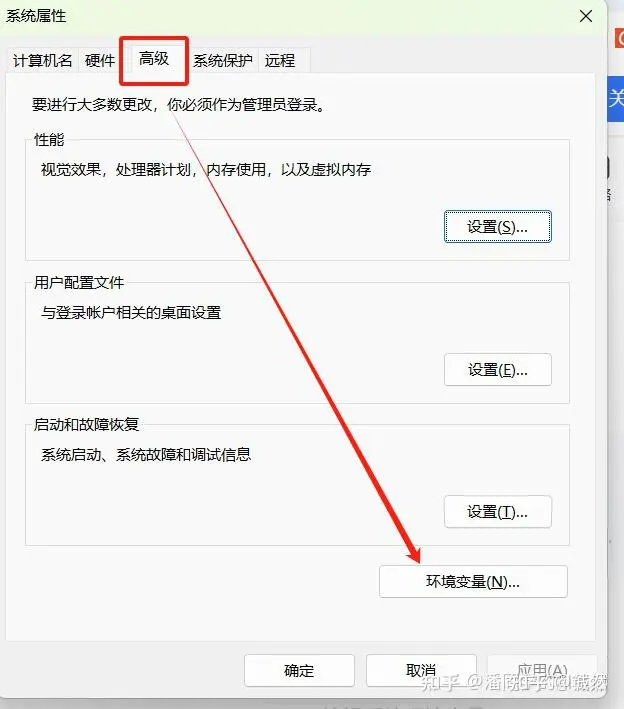

编辑环境变量

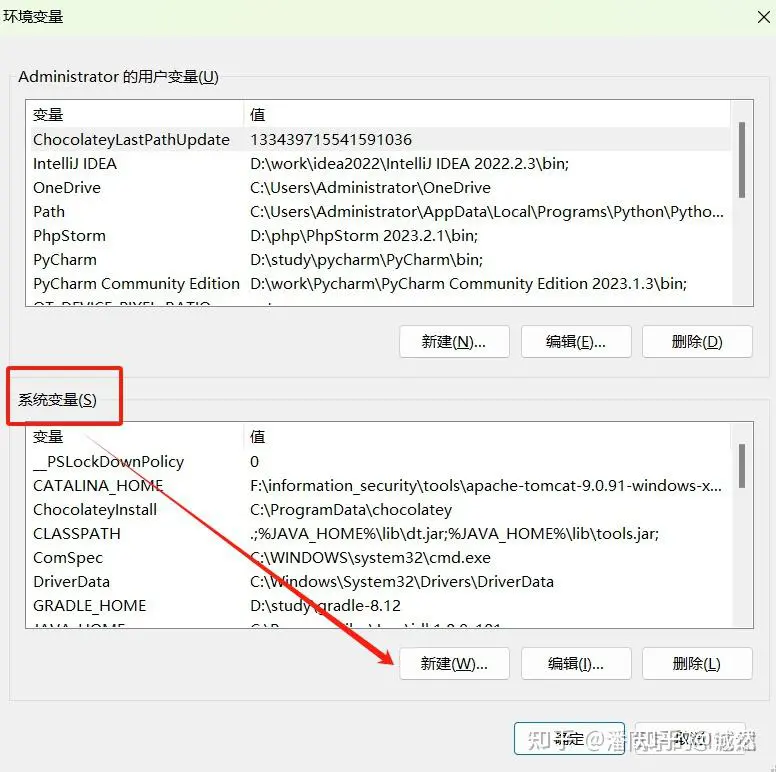

新建一个系统环境变量

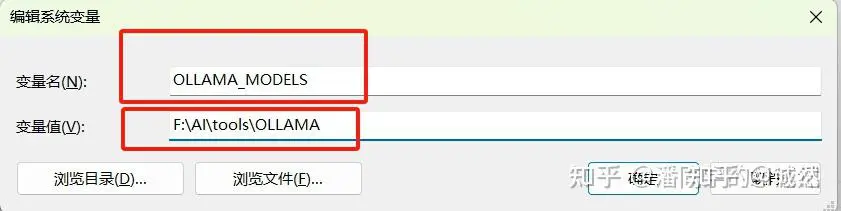

变量名请一定写OLLAMA_MODELS

然后变量值,就写你模型下载所下载到的路径

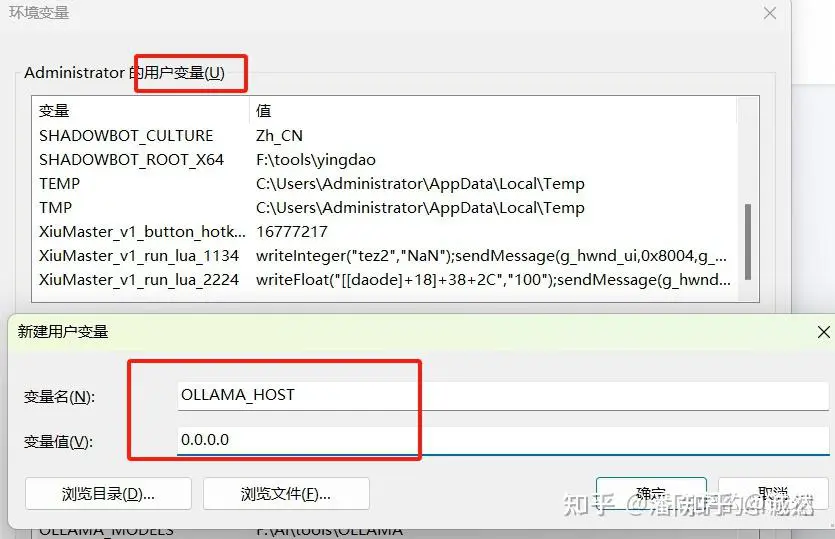

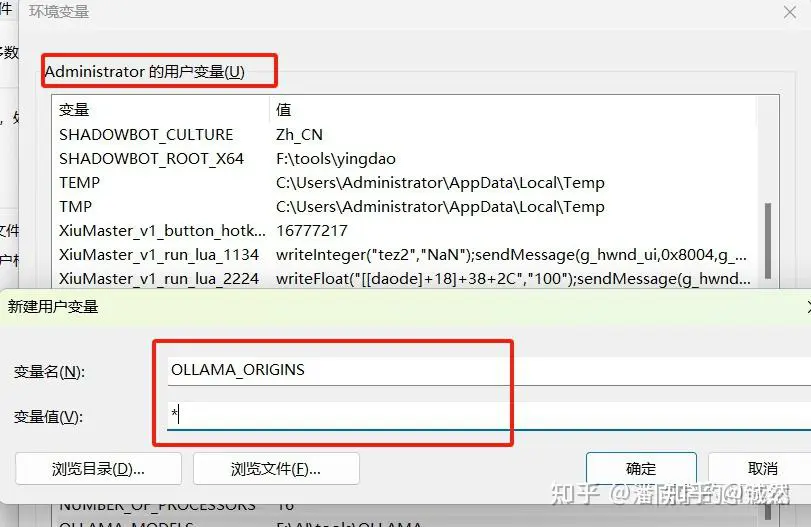

然后还需要去用户环境变量里,新增两个环境变量

OLLAMA_HOST:0.0.0.0

OLLAMA_ORIGINS:*

都设置好后,就保存,然后重启ollama

2.chatBox下载安装

Chatbox AI官网:办公学习的AI好助手,全平台AI客户端,官方免费下载

我们通过ollama下载模型后,可以在命令行使用deepseek了,但是命令行的形式还是有些不美观,所以我们可以借助chatBox,它拥有美观的UI,只要接入ollama的Api就可以使用了。

也是可以多平台下载,我这里选择windows下载

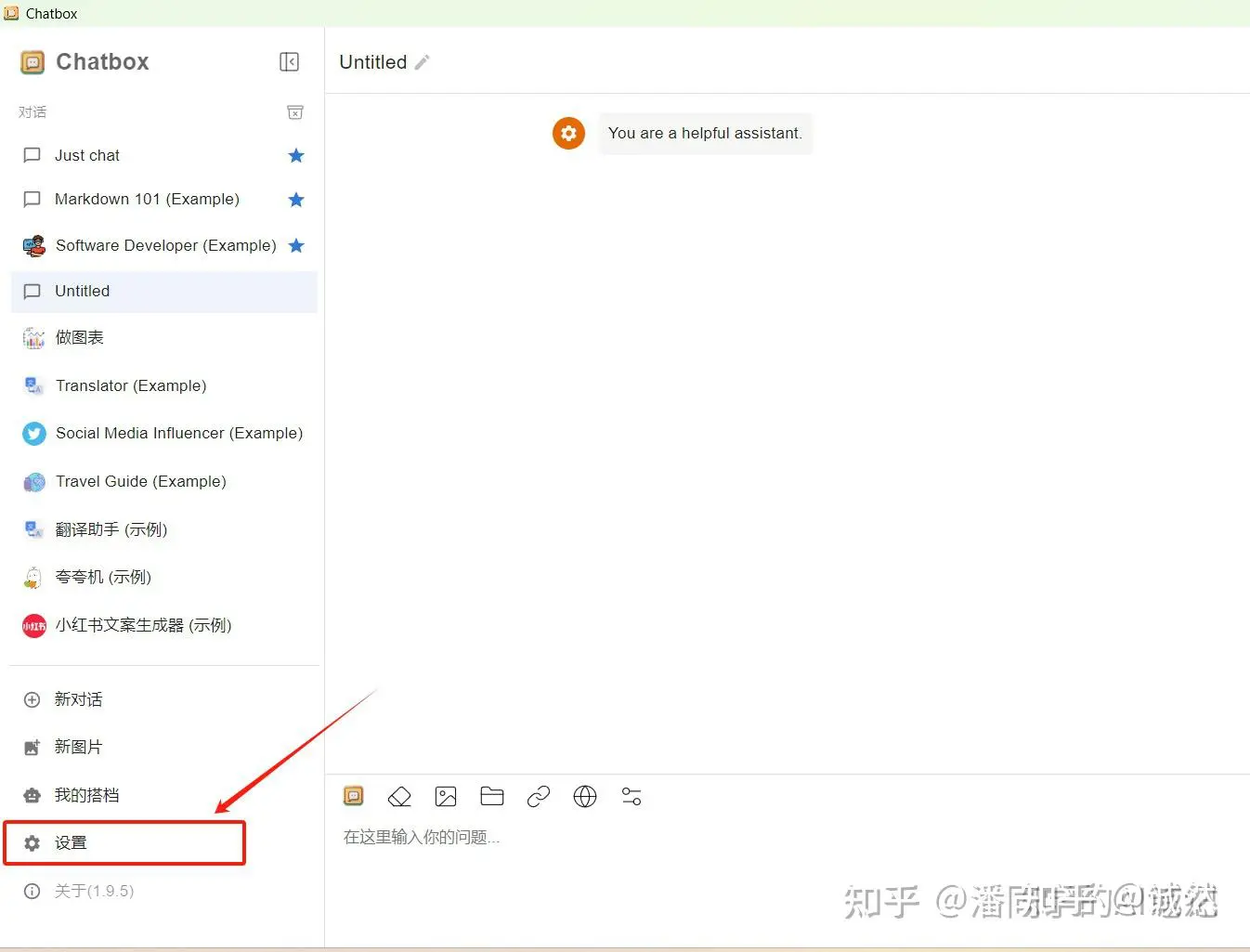

安装启动后,点击设置

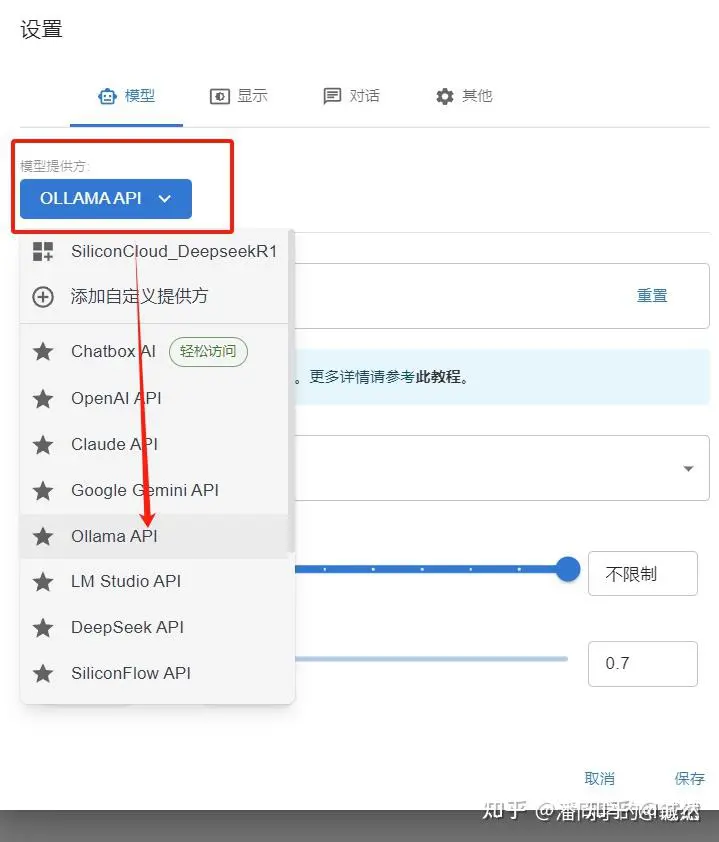

模型提供方选择ollama API

然后现在可以选择模型了

能成功使用

注意:选择蒸馏模型的大小,需要结合自己的电脑实际情况来选择,这会关系到,模型回答的速度以及效果问题。

最后我想说:

特斯拉的颠覆性创新,从来不只是硅谷实验室的灵光乍现,而是整个北美科技森林共生共荣的果实。他们总能在技术拐点到来前三年埋下种子,用工程师文化浇灌创新萌芽。中国人工智能的破局,正需要这样的生态雨林。

太多国产操作系统止步于实验室,恰因缺少开源的阳光雨露,只能做技术潮流的追随者。因此,中国必须要有自己的数字原住民,在代码荒原上开垦出开源社区。

我始终相信技术平权的力量,就像三十年前没人能想象农民直播卖货,而今天数字技术已渗入每个乡村角落——(当世界还在争论AI伦理时,我们的AI工程师正在帮陕西老农用大模型预测苹果期货价格!这才是真正值得自豪的突破)

暂无评论内容